国华的世界

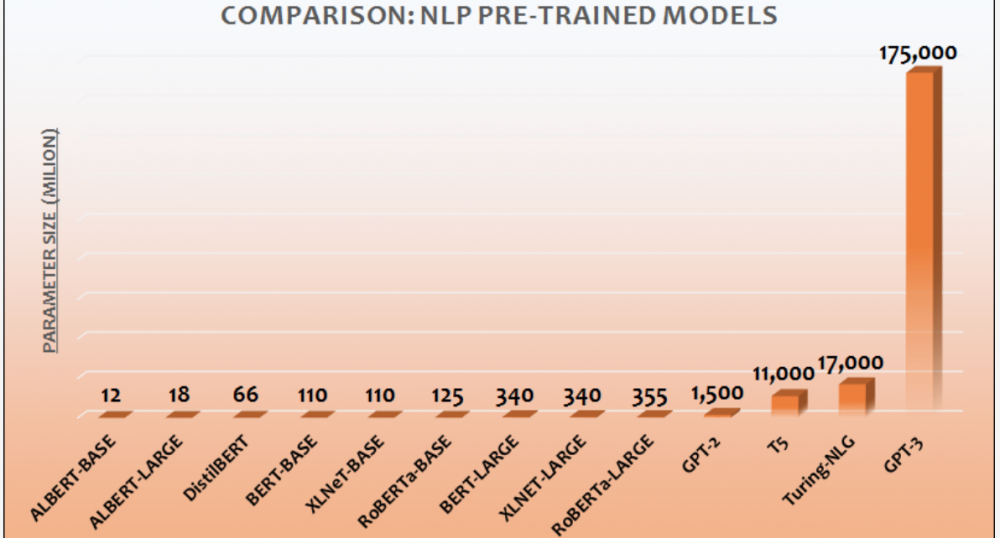

这是国华对读过的书, 看过的电视/电影, 听过的音乐, 访游过的地方, 经历过的事物, 和时事的感想或点评.当美国开放式人工智能(Open AI)的GPT-3模型(下图 analiticSteps)在2020年6月首次发布时,它的性能被广泛认为是最先进的,其技术已超越 AlphaGo 。GPT-3是语言模型中的全能学霸,他不仅会写短文,而且写出来的作文挺逼真的,几乎可以骗过人类,据说几乎通过了图灵测试。在无监督下的自主学习能力非常强,GPT-3能够从人类精心制作的散文中生成难以辨认的文本,从而为深度学习树立了新的标准。通常,一个语言模型首先要能理解自然语言,比如给出两个句子,语言模型会判断哪个句子更像自然语言、句子里面的词或短语的依赖关系是什么;其次,语言模型能对自然语言做预测,如只给出一句话的前几个字,语言模型根据语言规律来预测后面的字是什么。GPT-3 完全具备这两项能力。GPT-3 的厉害之处可以用三个词来总结:多任务(multi-task)、无监督(unsupervised)、小样本动态学习(few-shot learning)。

具体来说,GPT-3之前的模型一般只能处理单一的任务,对每一个应用场景都要单独训练模型。比如针对翻译考试要单独训练一个翻译模型,针对做数学题要单独训练一个数学模型。但是 GPT-3 可以在单一模型里处理多个任务,而且每一个任务都处理得不错,仿如一位科科都得高分的全才学生。另外,考试的时候,GPT-3 可以应对人类自由风格的综合面试,人们可以在自然的对话中随意出题,问题可以是天文、地理、历史、算术等穿插着进行。GPT-3保证回答完美,最终以参考生中的最高得分手胜出。

本身就这么优秀了,它还非常自律,GPT-3在学习过程中完全不需要监督、非常积极主动,且自学能力爆棚,学习过程中根本无需人们提供有答案的练习题来复习测验(微调模型)。

只要给他提供无限多的文本序列,GPT-3就能自动从文本里学到各种知识。其学习成长经历,就像从一个咿呀学语的小孩开始,在教会他最基本的拼音识字(类似于 GPT 里的数据编码)后,给他《世界通史》《四大名著》《算数启蒙》(下图 Google Images)等各类书籍,他就会开始主动地自学,不需要老师辅导或向谁请教。前面讲到语言学习,这儿再以写计算机程序为例。以前都是人类去写程序。现在有了GPT-3,人类写一个人工智能算法后,算法自己即可从数据中推导出程序。就这样通过一段时间的自学,GPT-3将会成为一个不偏科的跨学科学霸。

GPT-3能够做到这些,是因为该算法模型接受了1750亿个参数,跑通了新的人工智能技术路线,以及雄厚的财力和(科技)人力(下图 asb)。训练超大GPT-3模型,须使用超大规模GPU机器学习集群。人工智能模型训练一次的花销是千万美金,而一颗卫星的制造成本已经降到50万美元以下。OpenAI还有足够的相关领域人才从技术上保障项目的成功。GPT-3 是几十人的有组织的系统性合作,有人出主意、有人搞数据、有人写代码、有人做实验、有人做评测。模型参数从1750 亿,这本身就是巨大的工程挑战,需要那种既懂基础算法、又有超强的工程能力的科学家和工程师一起通力协作才有可能做成。虽然运行人工智能模型比卫星成本还昂贵,但OpenAI的钱袋深,不缺钱,耗得起。

得,如此之多的溢美之词,还不知道GPT-3的应用的场景如何呢。你别说,应用的场景多着呢 -- GPT-3基本是一个增强版的搜索引擎或 AI 助理, 它可以回答问题、编程、写新闻稿、数学推理、做财务报表…… 信不信由你,很快GPT-3 语言方面的能力就要超过 99% 人类了。这是否意味着大部分人将失业呢?不知道,但肯定从事AI的人是不会的。也不用过分焦虑,曾经出现的许多新技术、新事物,不是也创造出许多新的就业机会吗?抱歉,此乃题外话。

最后咱来认识认识GPT-3的研发者OpenAI(开放式人工智能实验室) (下图1)。顾名思义,这是美国一家从事人工智能(AI)研究的科技企业,据认为是世界三家顶级AI实验室之一,由盈利公司(OpenAI LP)及其母公司非盈利开放式人工智能(OpenAI)公司组成。除GPT-3外,OpenAI的人工智能图像生成器 DALL-E也在AI界广为人知。OpenAI被认为是谷歌DeepMind在人工智能领域研究的竞争对手。OpenAI创立的时间并不长 -- 由伊隆·马斯克 (Elon Musk)、萨姆·奥特曼(Sam Altman) (下图2 Google Images)和其他人共同出资10亿美元2015年底在旧金山成立。马斯克于2018年2月从董事会辞职,原因是与特斯拉人工智能自动驾驶汽车的开发存在“未来潜在的利益冲突”, 不过马斯克一直保持捐赠者的身份。2019年,OpenAI LP获得了微软10亿美元的投资。OpenAI的董事长兼首席技术官为格雷格·布罗克曼(Greg Brockman),任职OpenAI前,他曾担任爱尔兰/美国金融服务和软件服务公司Stripe的首席技术官,也是Stripe的第三名员工。OpenAI的首席科学家/研究总监为伊利亚·萨茨凯沃( Ilya Sutskever),之前曾在谷歌出事人工智能研究工作,担任谷歌机器学习专家。OpenAI的首席执行官萨姆·奥特曼(Sam Altman)也是OpenAI的创立人之一。此前,他任职创业加速器Y Combinator,担任总裁.

GPT-3发布后OpenAI LP一时间风光无两,前/钱途一派光明,似乎就坐等各种商用开发,然后在家数钱就行了。可科技进步无止境,江山代有人才出。这不,GPT-3发布一年之后,超越它的新型人工智能模型就问世了。竞争,果然是激烈地,尤其当竞争是在美国和其的头号竞争对手中国大陆间展开的时候。欲知后事,请待下文分解。

未完待续

参考资料

在野. (2020). 对话出门问问李志飞:GPT-3 是「暴力美学」的一次胜利. GEEKPARK. 链接 https://www.geekpark.net/news/263849

智源社. (2021). 区智源x清华开源FastMoE,万亿AI模型基石. CSDN. 链接 https://blog.csdn.net/BAAIBeijing/article/details/114389119

谭婧. (2020). 史上最大,人工智能算法模型GPT-3问世,这意味着什么? 澎湃. 链接 https://www.thepaper.cn/newsDetail_forward_8052804

BAAI. (2021). BAAI. 链接 https://www.baai.ac.cn/en

Bama, A. (2021). This Chinese Super Scale Intelligence Model, ‘Wu Dao 2.0’, Claims To Be Trained Using 1.75 Trillion Parameters, Surpassing All Prior Models to Achieve a New Breakthrough in Deep Learning. MARKTECHPOST. 链接 https://www.marktechpost.com/2021/06/13/this-chinese-super-scale-intelligence-model-wu-dao-2-0-claims-to-be-trained-using-1-75-trillion-parameters-surpassing-all-prior-models-to-achieve-a-new-breakthrough-in-deep-learning/

Black, D. (2021). China now has the most powerful neural network: it is many times smarter than competitors from Google and Open AI. World Stack Market. 链接 https://www.worldstockmarket.net/china-now-has-the-most-powerful-neural-network-it-is-many-times-smarter-than-competitors-from-google-and-open-ai/

He, H. (2021). China’s GPT-3? BAAI Introduces Superscale Intelligence Model ‘Wu Dao 1.0’. Synced Global AI Weekly. 链接 https://medium.com/syncedreview/chinas-gpt-3-baai-introduces-superscale-intelligence-model-wu-dao-1-0-98a573fc4d70

Naik, A.R. (2021). Wu Dao 2.0: China’s Answer To GPT-3. Only Better. AIM. 链接 https://analyticsindiamag.com/wu-dao-2-0-chinas-answer-to-gpt-3-only-better/

OpenAI. (2021). About. 链接 https://openai.com/about/

Tarantola, A. (2021). China's gigantic multi-modal AI is no one-trick pony. yahoo!finance. 链接 https://finance.yahoo.com/news/chinas-gigantic-multi-modal-ai-is-no-one-trick-pony-211414388.html

Wiki. (2021). OpenAI. 链接 https://en.wikipedia.org/wiki/OpenAI

“科普得很好。”

“还有人唠唠叨叨说要多生小孩儿么?”

“天哪!你的第一段就把我一腔的导师的”音声认识“的研究,用如此形象的文字如实地介绍给了读者,引人入胜!

今早,这里的早间国际新闻报道了在上海(好像是)的AI展览会,“人机共存的时代” 来到了!”

“科普得好。”

"难得的好文章"

今早,这里的早间国际新闻报道了在上海(好像是)的AI展览会,“人机共存的时代” 来到了!