我一向不喜欢人多,唱大戏式的热闹,顺带不喜欢热闹话题。

大概也就不小心赶上过一次。当时写普京的秘密,第一篇选的是瓦格纳,结果话音落地没多久,那个组织出事。于是中文网关于它的介绍铺天盖地。我粗粗扫一眼,这都哪儿跟哪儿啊,分明不如我随便看看顺嘴胡编的那几句有内容。

这次是看老键又有长吁短叹整离骚的架势,一剑一个巴掌揉三揉的调戏人家。我不仗义吗,打个岔说两句好了。

好了,今年的诺贝尔物理奖是俩人(好像这些年一直是分了,大概一个人发现什么元素什么物理现象的好时光一去不返了),John Hopfield 和Geoffrey Hinton。 委员会给的评价是used tools from physics to construct methods that helped lay the foundation for today’s powerful machine learning 。

到底是怎么用的?They used physics to find patterns in information.

这个思想最早,要追溯到1982年,Hopfield的一篇文章,Neural networks and physical systems with emergent collective computational abilities,发表在Proceedings of the National Academy of Sciences of the United States of America。那份杂志是创刊于1915年的周刊,有点像SCIENCE,什么科技文章都可以投,但是他的侧重是生物学和医药类,2019的Impact Factor是9,412(很厉害了)。

我给这些数据的意思是,那本杂志不错,知道的人很多。文章不长,加参考文献才5页,被算在Biophysics栏下。为了写这个,我从网上找出啦大概看了一下,基本思路是公式的讨论完给出一个算法。当时的Hopfield,是49岁。

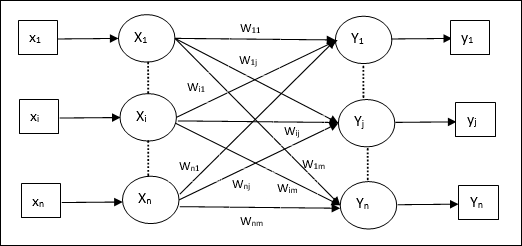

在那篇文章里,他第一次提出了associative neural networks这个概念(后来被称为Hopfield networks),简单解释就是网络(network)由两部分组成,Nodes(weights)+Connections,每个Nodes权重不同。Hopfield用这个模型来描述人类大脑中的神经元组织工作的过程。

你把数据塞进去,然后生成一种存储模式(pattern),然后update涉及到节点的权重,生成新的pattern,计算新生成的pattern和已有pattern的距离。通过这个简单的迭代过程,达到最后可以接受的pattern。

我随便从网上找了一个示意图。Hopfield的原文里是没有这个图的,他只给了最简单的正态分布来描述memory states产生的noise。

这个模型当然因为太简单甚至可以说粗陋,也和我们今天用的相差很远。但是它厉害的地方是,基本思路是不差什么的。

这就是原创的意义。你做出了以前没有的东西。所以手工的东西值钱,因为世界上只有一件,没有第二件可以完全一摸一样的,不是MASSENPRODUKT能比的。

呃,比如我前几天花11个小时给我们姑娘做了一条毕业舞会的舞裙。

她网上店里看一溜够,还是觉得没有自己想要的。迟迟疑疑说,妈妈我想你给我做一条。

她妈妈我只好咬牙接下那份工作。

一个月迟迟没有开工,急的WHATSAPP我,妈妈你说好10月份你能有的,到现在我看你针也没碰剪刀也没动,你变出来吗?

我于是BLOCK一个星期天(真的连本地选举都没去),到晚上8点,终于完工。

穿上(臭)美极了。站在镜子前根本不想离开。因为是白色,最后跟我说,妈妈你说我将来HOCHZEIT还穿行不行?

我说你没那么惨,HOCHZEIT妈妈最多再做一条新的。

这世界上当然没有第二条,因为没有第二个我。

总结一下Hopfield的模型,基本是以下几个部分,Memory(存储数据), updating(更新pattern), evaluation(评估结果), deterministic(给出结论)。如前文所言,是很basic的Limit Learning。

有千里马就有伯乐。

Geoffrey Hinton读到这篇文章之后,马上开始试这个模型并试图改进它。

Hinton的方法是,在已经有的Hopfield networks基础上,用很严格的rules,具体说是统计力学里的Boltzmann Distribution,生成一套学习算法(Learning Algorithm),来完成对pattern的生成。包括增加多次隐藏layers,用那个数据做backpropagation。

Hinton 是British-Canadian,在google工作多年,被称为AI之父(Godfather of AI)。在2023年5月离开。他自己给出的离开原因是,他希望能自由发表对AI这件事的看法(网上有对他采访的原文,我不贴连接了,很容异找到)。

他的观点是,

Machines are closer to humans than we think。

We are breeding a superior species that we won’t be able to control。

。。。。。。

很多科幻电影都有抄这个思路的。导演胡编的吗?

诺贝尔委员会对这次物理奖强调的是,the Neural network has been very useful in Physics. They are used for data analysis, modelling, for analyzing data that produced by the models.

现在资讯发达,这些都很容易找到,我不多重复。

而且不用担心是Fake News。

至于我自己,你问我的看法,我会说,很好啊。最多算是对物理的定义宽泛一点而已。再早,在古希腊的小孩子(还得是男孩,8岁以后),不是只有两门课可以上?体育和数学。

后来自然科学越分越细,社会科学也各成一派,如果再往回走。我觉得没什么。

我能接受。我又不是老键。