原乡人

直性直情直白天下,求真求善求美人间。

人工智能AI模20多年前还只是一只丑小鸭,很长时间没有被科学界学术界,尤其是统计界充分的认可和使用,虽然大部分的AI模也用了概率统计的一些基本方法。记得当时很多年美国统计学家协会(ASA)都不承认NN和AI是统计专业领域的。97年我在当地医学院工作,当时的老板拿了一笔研究经费,目的专用于介绍和引进新的数学统计模式给医学院各系的研究人员。当时考虑的一个AI模就是最早被发明和使用的Neural Network(NN),都是计算机专业或者程序语言能力强的人自发研究创造的模。但我们和一些专家观察和评估了使用及结果,最后NN模没有被通过和采用, 而是推荐引进了Latent Class Model(LCM)。

2000年后,一些大的统计软件如SAS E-Miner都包括了NN模,但在实际应用中,尤其是科学研究发表的使用数据统计和定量分析的文章中,都几乎很少被使用。主要的原因之一在于,比如NN模, 什么线性、非线性的变量都能够输入,而数据处理的过程本身和方法论(methodlogy), 就像一个难以进行定量分析和描述的黑盒子,最后输出的结果也很难给予解释。常常被人暗下嘲笑为 garbage in and garbage out。

但过去的10多年来,丑小鸭终于变成了白天鹅。随着计算机科学、人工智能科学和数据科学等的飞速发展,以及这些科学之间的交叉学科的不断出现,更加速了人工智能模式的成熟应用和具体成果。AI模不仅仅在图像处理、语言处理、机器学习、自动驾驶、影像分析、医疗诊断、以及战场态势感知、战场决策、自动武器系统等,也在数据分析等等领域里得到了较大的发展和应用,其结果和成果越来越让人刮目相看。据说谷歌的象棋冠军AlphaZero,就是类似于下图的一种最高端的三层的深度学习的NN模。AlphaZero使用深度神经网络和蒙特卡洛树搜索算法的组合来评估位置并做出决定。

人工智能AI今非昔比啦。虽然对算法和模式程序的处理过程,结构和功能以及结果和方法论的解释还是没有那么精确和完整。但结果和市场可以证明和说明一切。比如,我们和最大的几家金融公司,从2017年开始就使AI的单层NN模,替代原来的数学统计模来做现金流的预测,精确度和顾客使用的满意度都比过去的数学统计模好些。 到目前为止,全公司各个领域所使用的几百个登记注册的Models,有将近30%是AI模了。并且AI模已经和所有的统计模分别开来,主要由计算机专业和数据科学领域的专家进行管理。目前, 公司已经允许各个部门的100个R&D专业人员,测试使用和评估ChatGPT和其他的AI语言软件。不久将会决定是否会购买和使用这些全新的AI工具。也有大公司已经在研究发展使用AI技术进行股市投资决定和风险管理。

玩了几天ChatGPT的几点初步感受

根据ChatGPT自己的介绍,它是一个由OpenAI开发的人工智能语言模型。它是基于GPT(生成性预训练转化器)架构,并且已经在互联网上的大量文本数据上进行了训练,使其能够生成连贯的、与上下文相关的反应。ChatGPT能够理解并以对话方式生成文本,使其适用于回答问题、提供解释、提供建议、参与讨论等任务。它还可以处理广泛的主题和领域,尽管它的反应是根据训练数据中存在的模式和例子生成的,可能并不总是反映最新的信息。

第一,What? ChatGPT有一个大规模训练得出来的数据集。虽然不知道它产生的内在结构和功能,但通过其的产品和结果可以推断,它过在大量阅读的基上,通过上深入浅出地总结出来的一个语言和知识浓缩为的精华数据集。总之而言,巧妇难为无米之炊,没有好的食材,再好的厨师也难做出高超的美食出来。尽管偶尔可能也会出现"化腐朽为神奇"的小概率现象。

在美国的研究生院,学生上课经常被要求阅读大量的书籍和文章,并能够在最短的时间内抓住其重点要点,浓缩成为高度结构性的精华。比如,你读了学术杂志上一篇20页的文章,归纳总结出了10个重点,首先,根据文章的内容来看,这些重点概括总结得很完整(completely exhaustive),没有较大遗漏。同时,这些重点之间,在内容逻辑的同一层次上都是相对独立, 互相不重复的(mutually exclusive)。现在的ChatGPT几秒钟就可以完成,而你即使有过速读的训练和一定的专业知识,也至少要花费半个小时以上。另据报道,微软正在准备整合AI语言模Copilot到MS Office中,其中有一个功能可以快速地阅读和总结任何输入的文章。最后,10个重点总结出来了,不是杂乱无章的任意堆砌,还需要根据主题内容进行权重和排序。哪个排第一,那个排第10。这都需要make sense。

第二,How? 结构决定功能,从功能也可能反推结构。GhatGPT应该是一个根据语言概念的不同层次整合在一起的、随机流动性(语言文字的多样性和可互换性造成的)较强的一个动态结构体。训练过的数据集肯定不是一大堆自然的语言概念的堆积。它的语言基本单元是已经是被总结上升到一定层次的类似神经元结构化的整体。

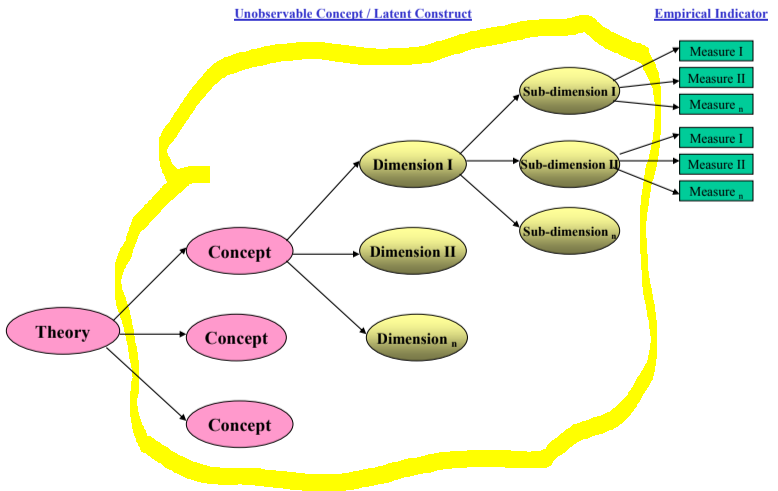

太阳底下无新事。ChatGPT虽然是刚刚出现的新事物,但它使用的人类思维的内在逻辑和方法肯定不是第一次出现的东西。可以推断它的第一个语言逻辑算法的基本规则和方法,应该是子系思维方式,也就是每个事物和现象在语言概念上至少可以分3层,即从上至下分为:母系统(sup-system )、系统(system) 和子系统(subsystem) 。在处理问题的时候,每个层次根据自己算法系统和整体算法系统的规则进行排列组合,生成最佳的回答。这也是NN类似于神经元结构的模式。以下图中间三个层次就是子系思维方式的典型例子。

可以推断ChatGPT的语言逻辑算法的方法自然是根据数据集的特点来进行的。每个问题从语言概念的点,处理到所有相关的线,再处理到所有相关的面,就像人的神经元一样,多线条的、多维多面的不断的进行相关性整合, 最后处理到整体回答。

同时,ChatGPT的结果可以看出来,它的算法和逻辑依旧继承和使用了人类的一些思维和知识建构的基本方法,诸如归纳推理(button up)和演绎推理(top down);发散性思维和聚敛性思维;还有"天下文章一大抄",概括、总结也是一种创造的至理名言。当然,戏法人人会变,各有巧妙不同。每个的AI软件也都是有自己的特点和特色。

第三,Why? 由于训练时使用的数据集包括了网络上最广泛的信息资源,也就是最大范围的数据库。所以海纳百川, 有容乃大,不仅仅最后回答的判断处理根据ChatGPT自己的回答就是:"在生成反应时,ChatGPT使用概率分布来确定上下文中不同单词或单词序列的可能性。它根据它从训练数据中学到的模式计算条件概率。然后,该模型从这些分布中取样,考虑到上下文和不同单词或短语出现的概率,生成一个响应。"总之,ChatGPT生成的回答应该都是人类社会和知识中的大概率事件和现象。不仅从商业层次考虑,ChatGPT性质上也应该适用于最大多数和普遍的国家和人群。并且, 从商品和产品最终的目的来看,应该遵循于服务最广大人民群众的利益。所以社会中的极端份子会比较失望的。比如, 你问一些极端的问题,中美战争,FG或者台独,得到的回答都是很中性, 并且比较客观的。

最后感受:ChatGPT和人类思维工具的发展都有着一个同样的规律,即工具越先进越发达,人类主体的主观能动作用越重要。这不仅是充分认识和掌握工具的功能特点,知道如何正确充分的使用它, 还必须要有正确的观念和理论指导和引导你得出正确的问题。ChatGPT也是如此,一言以蔽之,你的问题决定了你会得到的回答的质量和好坏,也决定了这个工具的能够提供的功能和质量的高低。对此有人总结出,提出问题比解决问题更重要。同时,你的知识积累和能力也最终决定了你是不是识货,还是视而不见,擦肩而过,无法真正的使用和利用好AI工具产生的结果。

以下就是几点具体的经验和感受,包括了一些有意思的例子。

ChatGPT训练过程中使用的数据库有多大?

天下文章一大抄,ChatGPT抄的是天下的文章,不仅仅局限于有名有姓的一两处的文章。ChatGPT的训练并不是基于特定的数据库,而是通过对大规模互联网文本数据进行训练。OpenAl使用了广泛的互联网文本数据集,包括维基百科、网页文章、论坛帖子、新体来说闻文章等等。需要注意的是,ChatGPT的训练数据是通过对大量的互联网文本进行自监督学习来实现的这意味着ChatGPT在生成回复而不是针对特定数据库或特定领域的数据集进行有监督训练。

关于具体数据集的大小,OpenAI并没有公开透露详细的信息。由于训练过程涉及庞大的计算资源和时间,以及数据使用权等方面的限制,具体的数据集规模和组成是OpenAI内部管理和决策的内容。

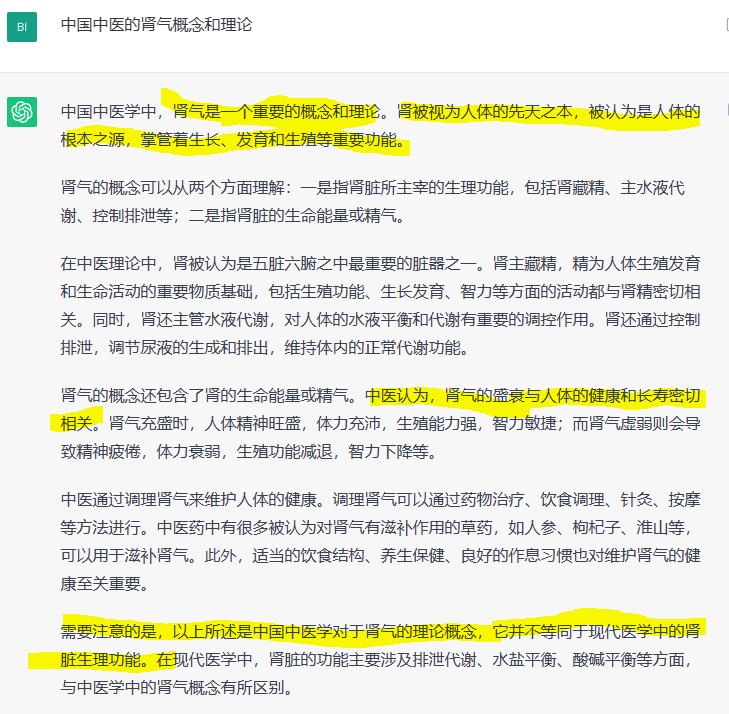

但当你察觉到所问的问题回答的文不对题,或者有错误,那么自然而然的原因就是因为数据集没有足够的数据和知识的支持。比如,我问中国中医关于"肾气的理论和概念",ChatGPT回答的比较完美周全。

但我又问中国中医关于"湿气的理论和概念",显然基本概念回答错误。因为中医的关于湿和湿气的理论,在一开始就区分于通常物理学概念上的水和湿,而是一个包含生理、病理、生态环境和人的整体性的一个形而上的概念。只怪ChatGPT有关中文和中医的书读得不够多,知识积累的不够全吧。

ChatGPT的数据更新的时间框架是什么?

作为一个人工智能语言模型,ChatGPT回应是(As of May 2023): "基于互联网和其他文本来源的训练处理,我的知识截止日期2021年9月。这意味着我的反应反映了截至该时间的信息和事件,我无法获得该时间点之后的实时或更新信息"。比如,我试问了一段上两个月刚刚出来,在中国国内轰动一时的女幼儿园老师的歌词。显然ChatGPT没有料,但判断正确是一个与文学相关联的问题,从而瞎凑出了下面4段挺有意思的白话诗。显然应该记住,目前为止ChatGPT数据集和任何现在的时差是20个月。也就是说,当你问任何发生在刚刚过去20个月时间内的东西时,预期可能得不到正确的答案。

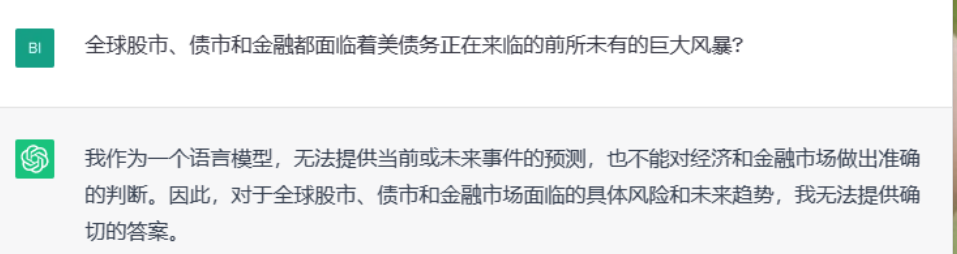

至于ChatGPT可以用应用于预测股市? 下面是它自己的回答,当然不否认,华尔街一直有自己的预测股市的软件,其数据的更新也是每天的、甚至即时的。

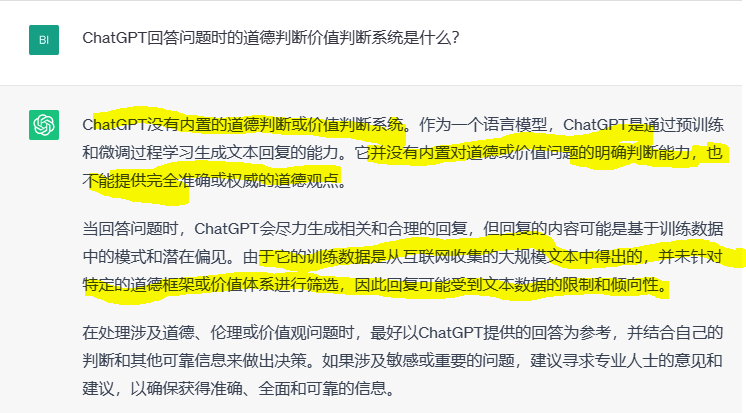

ChatGPT回答问题时的道德判断价值判断系统是什么?

ChatGPT没有内置的道德判断或价值判断系统。作为一个语言模型,ChatGPT是通过预训练和微调过程学习生成文本回复的能力。它并没有内置对道德或价值问题的明确判断能力,也不能提供完全准确或权威的道德观点。当回答问题时,ChatGPT会尽力生成相关和合理的回复,但回复的内容可能是基于训练数据中的模式和潜在偏见。由于它的训练数据是从互联网收集的大规模文本中得出的,并未针对特定的道德框架或价值体系进行筛选,因此回复可能受到文本数据的限制和倾向性。

ChatGPT使用任何数学统计的模式吗?

是的,太阳底下无新事。ChatGPT说,它在其训练和生成过程中利用了数学和统计模式。它是基于一种称为变形器(transformer)的深度学习架构(deep learning architecture),这是一种神经网络模型(neural network model)。变形器使用数学运算,如矩阵乘法和非线性激活函数,来处理和转换输入数据。

在训练阶段,ChatGPT通过一个称为梯度下降(gradient descent)的过程优化其模型参数,学习训练数据中的统计模式。这涉及到计算梯度和更新模型权重(model weights),以最小化生成的输出和训练数据的目标输出之间的差异。

在生成反应时,ChatGPT使用概率分布来确定上下文中不同单词或单词序列的可能性。它根据它从训练数据中学到的模式计算条件概率。然后,该模型从这些分布中取样,考虑到上下文和不同单词或短语出现的概率,生成一个响应。

总之,数学和统计模式是ChatGPT使用的底层深度学习架构和训练过程的基本组成部分。这些模式使模型能够从数据中学习,并根据学到的统计关联生成反应。

一个做高深点学问的例子之一: 因果关系的概念和理论?

ChatGPT在不到1分钟内就提供了七个有关因果关系的理论。我比较了维基百科的几个有关的概念和理论的专题。ChatGPT的回答不仅是比较完整,也高度的精练。当然,由于概括程度太高,每个理论都只是蜻蜓点水,点到为止。比如,结构方程模型(SEM),在过去的20多年中,大量的应用在社会科学、经济学等领域内,也有大量的SEM因果关系定量分析和统计的教科书、文献和资料可以查询。以下是ChatGPT的回答。

因果关系是各个领域的一个基本概念,包括哲学、科学和统计。有几种关于因果关系的理论和观点,试图解释因果之间的关系。下面是几个与因果关系有关的突出概念和理论:

规律性理论: 根据规律性理论,因果关系是基于事件的规律性或模式。它认为,一个原因是一个事件,它的后面是一个具有高度规律性或频率的特定效果。这一理论强调对因果之间重复关联的经验观察。

反事实理论: 因果关系的反事实理论从反事实条件的角度来定义因果关系。它指出,一个原因是一个事件,如果它没有发生,效果就不会发生。这一理论通过考虑假设的替代方案和评估结果的差异来探索因果关系。

概率性因果关系: 概率因果关系承认,因果关系往往是概率性的,而不是决定性的。它表明,一个原因增加了一个结果发生的概率,但并不保证它。这一理论考虑了原因和结果之间的可能性或统计学关联。

机械式因果关系: 机械性因果关系理论着重于理解因果机制或过程,解释一个原因如何导致一个结果。它强调识别潜在的机制、相互作用和介导因果关系的中介因素。

代理和干预主义理论: 代理理论强调有意的代理人或行动者在因果关系中的作用。他们认为,因果关系涉及代理人的有意行动或干预。干预主义理论认为,原因是改变事件进程并产生特定效果的干预。

结构方程模型(SEM): 结构方程模型是一个统计框架,结合测量模型和结构模型来估计变量之间的因果关系。它使用定向路径表示因果关系,并允许测试关于因果效应的假设。

贝叶斯的因果推断: 因果推断的贝叶斯方法使用概率模型和贝叶斯统计学来推理因果关系。这些方法结合先验知识、观察到的数据和因果假设来估计因果效应和评估不确定性。

值得注意的是,因果关系是一个复杂的、哲学上的概念。不同的学科可能采用不同的视角和理论来研究因果关系。理论或框架的选择取决于背景、研究问题和被调查的因果关系的性质。

一个做高深点学问的例子之二: 马克思的理论对今天仍然有用?

ChatGPT: 卡尔-马克思的理论今天仍然具有影响力并被广泛讨论,特别是在社会学、经济学和政治学领域。虽然对马克思理论的相关性和适用性的意见可能不同,但以下是一些需要考虑的要点:

经济分析: 马克思对资本主义的批判和他对经济体系的分析仍然有影响力。他的概念,如阶级斗争、劳动价值论、异化和剥削,为理解经济动态和不平等提供了洞察力。在讨论收入不平等、全球化和财富分配时,马克思对劳动和资本之间关系的关注仍然具有现实意义。

社会不平等: 马克思对社会阶层及其对社会的影响的强调在今天仍然是相关的。他的框架强调了植根于资本主义制度的结构性不平等,使人们注意到财富和权力集中在少数人手中的情况。关于收入不平等、社会流动性和社会分层的讨论经常包含马克思的思想和观点。

政治经济学: 马克思对政治经济学的分析研究了经济体系、权力动态和政治结构之间的关系。他的历史唯物主义理论认为,经济条件决定社会发展,为理解历史和政治变化提供了一个视角。马克思主义关于国家、帝国主义和资本主义在塑造政治机构方面的作用的观点,继续为政治科学的辩论提供参考。

社会运动和行动主义: 马克思的思想在历史上影响了社会运动和活动。他对集体行动、劳工权利和工人运动的关注,激发了各种倡导社会正义、工人权利和平等的社会和政治运动。马克思主义框架继续塑造活动家团体和组织的分析和战略。

批评和不断发展的解释: 马克思的理论也面临批评,并随着时间的推移被重新解释。学者和思想家对决定论、历史唯物主义和马克思主义社会主义模式的可行性等方面进行了批评。此外,马克思的思想已经被改编和重构,以应对不断变化的社会、经济和政治背景。

值得注意的是,虽然马克思的理论提供了宝贵的见解,但它们并非没有局限性。对他的作品存在着不同的解释和改编,具体思想的相关性可能因背景和学科而异。参与马克思的理论涉及批判性分析,考虑其他观点,并了解其历史和知识背景。

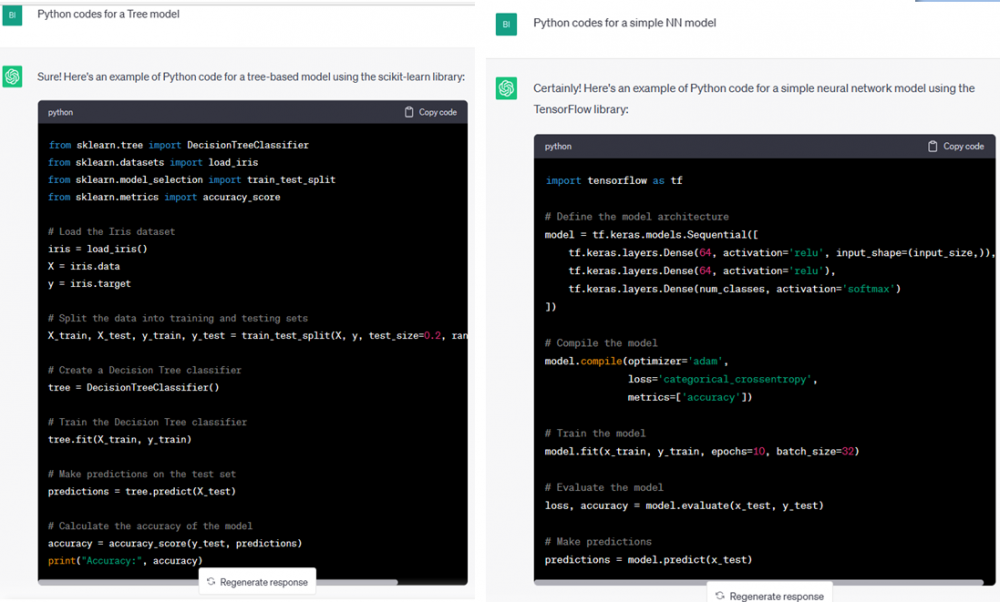

一个帮助专业领域的具体例子: Python, R and SAS Coding & Modeling Help

对于统计建模和分析、AI和数据科学领域,尤其对于做研究或者自学的人来说,ChatGPT提供了很好的咨询工具和专门问题的解答。下面是Python和R的两个建模的简单例子。至于ChatGPT可以提供多少深和多广的建模和程序语言方面咨询和帮助,还需要有具体的大量的使用才能够清楚了解。

最后, 当下红透半边天的英伟达CEO黄仁勋,在台大的毕业典礼上致辞说,AI正在重塑电脑产业,鼓励大家都必须学会善于用AI工具。心动不如行动,感兴趣的人赶快注册一个开挖吧。无论你到小小的花园里,还是到大大的花园里挖呀挖呀挖,最后都会得到收获和结果的!

Reference Link:

ChatGPT Link:

https://chat.openai.com/